Im Gespräch Das Gehirn verstehen dank Künstlicher Intelligenz

Von Menschen erdachte Computermodelle neuronaler Netzwerke können beliebig weit von der Realität entfernt sein. Trotzdem sind sie Forschenden eine große Unterstützung beim Planen und Auswerten von Lernexperimenten.

Warum es so mühsam ist, gelernte Verhaltensweisen wieder aufzugeben und wie auf Künstlicher Intelligenz (KI) basierende Computermodelle helfen, dies besser zu verstehen, erklären der Neuroinformatiker Prof. Dr. Sen Cheng von der Ruhr-Universität Bochum und Psychologieprofessor Dr. Metin Üngör von der Philipps-Universität Marburg im gemeinsamen Interview. Sie kooperieren im Sonderforschungsbereich Extinktionslernen.

Herr Professor Üngör, was ist Extinktionslernen?

Metin Üngör: Extinktionslernen umfasst alles, was dafür sorgt, dass sich erlerntes Verhalten wieder abschwächt und dann nicht mehr gezeigt, also extingiert wird.

Warum ist es so schwierig, bestehende Verhaltensweisen zu verändern?

Üngör: Eigentlich ist das ein guter evolutiver Anpassungsmechanismus. Wahrscheinlich spare ich Energie, wenn ich etwas mühsam Erlerntes nicht gleich über Bord werfe, sobald sich die Situation geändert hat. So bleibt es abrufbereit, falls sie sich erneut ändert.

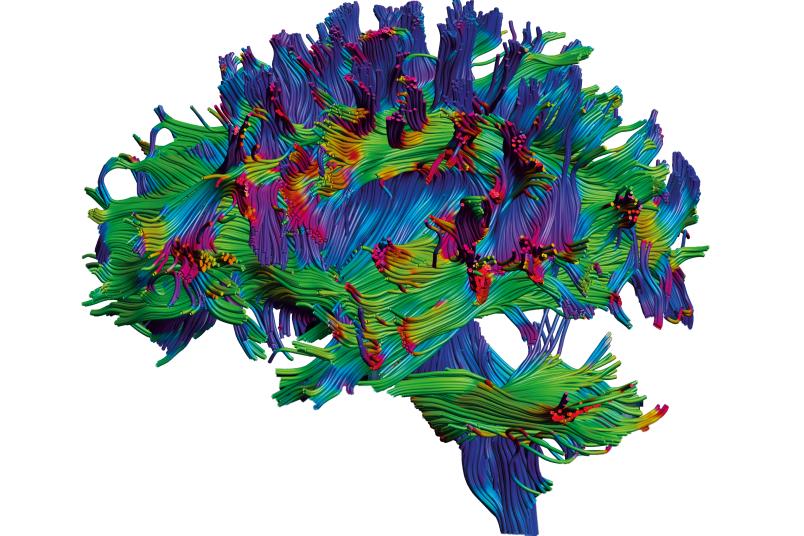

Sen Cheng: Außerdem funktioniert unser Gehirn nicht wie eine Festplatte. Wir können darauf keine Dateien finden und löschen. Das Gehirn speichert Informationen, indem neuronale Netzwerke ihre Verknüpfungen verändern. Sie liegen dann über diese Netzwerke verteilt vor. Deshalb ist eine komplette Auslöschung wahrscheinlich gar nicht möglich.

Welche Aufgaben übernimmt die KI bei Ihrer Forschung?

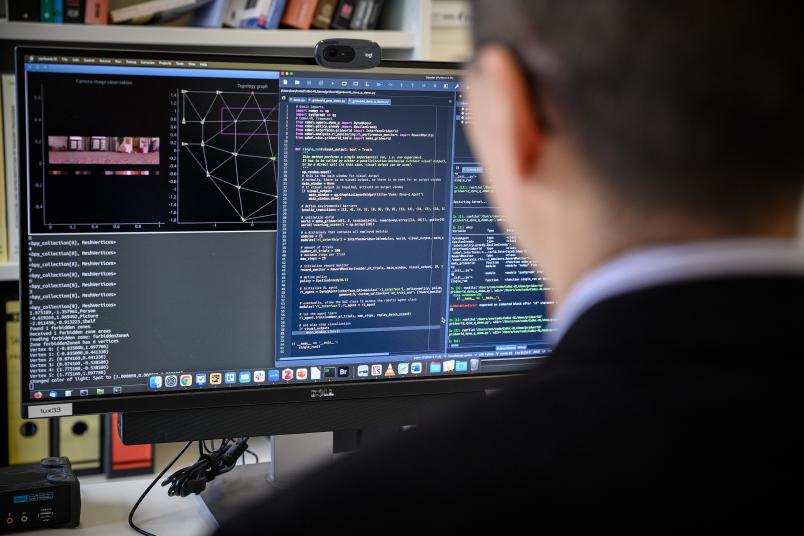

Cheng: Sie ist in der Lage, aus riesigen Datenmengen sinnvolle Informationen zu generieren. Wenn eine Nervenzelle im Gehirn aktiviert wird, sendet sie ein elektrisches Signal, ein Aktionspotenzial aus. Wenn ich von tausend einzelnen Neuronen diese Signale detektiere, erhalte ich tausend Zeilen.

Auf jeder davon sehe ich die einzelnen Aktionspotenziale einer Nervenzelle als Ausschläge nach oben. Darin muss ich dann einen Sinn finden. Die KI kann visualisieren, wie sich die gesamte Population von tausend Neuronen im Versuch verhalten hat.

Man kann KI auch als ein Modellsystem ansehen, das fähig ist, komplexe Probleme zu lösen. Ich forsche viel im Bereich der räumlichen Navigation. Wenn mein künstliches System lernt, in einer Umgebung zu navigieren, sehe ich genau, was in seinen nachgebauten neuronalen Netzwerken abläuft.

Wissenschaftsmagazin Rubin kostenlos abonnieren

Wissenschaftsmagazin Rubin kostenlos abonnieren

Kann man das nicht besser mit experimentellen Methoden sehen, mit denen man die Hirnaktivität direkt messen kann?

Cheng: Wir vergleichen die Daten der KI mit der neuronalen Aktivität, die wir aus den Gehirnen von Ratten oder Mäusen ableiten, wenn sie räumliche Navigation lernen. Die KI bietet aber einen viel besseren Zugriff auf das, was passiert. Weil ich weiß, welchen Algorithmus sie verwendet und in allen Einheiten ihres Netzwerkes gleichzeitig die Aktivität messen kann.

Wenn ich das künstliche System besser verstehe, hoffe ich, auch das biologische besser zu begreifen.

So lassen sich sehr schnell Ideen testen und Hintergründe erforschen. Wenn ich das künstliche System besser verstehe, hoffe ich, auch das biologische besser zu begreifen. Natürlich nutzen wir KI auch, um diese synthetischen Daten zu analysieren. So entwickeln wir Analysemethoden und -strategien, die man anschließend auch auf experimentelle Daten anwenden kann.

Welche Erkenntnisse erhalten Sie, wenn Sie eine Annahme mit KI testen?

Cheng: Unsere KI-Modelle sind vom Menschen erdacht und können beliebig weit von der Realität entfernt sein. Entweder muss ich meine Annahme danach verwerfen oder ich kann sagen, dass an ihr wahrscheinlich etwas dran ist. Inzwischen hat man eine grobe Vorstellung davon, welches Hirnareal was macht. Aber wie genau die Aktivität der unterschiedlichen Neuronen dazu führt, dass ein bestimmtes Verhalten entsteht, ist immer noch nicht gut verstanden.

In meinem KI-Modell habe ich unterschiedliche Typen von Neuronen und kann testen, ob sich das Modell erwartungsgemäß verhält, wenn ich eine bestimmte Population von ihnen aktiviere. So probiere ich Dinge aus und bekomme Ideen, wonach ich genauer gucken sollte.

Bei welchem Forschungsthema verwenden Sie gerade KI?

Cheng: Beim Lernen. Es ist Standard, sich das Verhalten vor und nach dem Lernen anzugucken. So bekommt man jedoch eine Sicht, die vielleicht nur sehr wenig mit der Wirklichkeit zu tun hat. Ein gutes Beispiel dafür sind Lernkurven.

Lernt ein Individuum schnell, steigt seine Lernkurve schnell an, lernt es langsam, steigt sie langsam. Mittelt man die Lernkurven vieler Personen, sagt das Ergebnis nichts mehr darüber aus, wie ein Individuum lernt. Dann sieht es so aus, als ob man immer ein bisschen dazulernt, bis man irgendwann nicht mehr besser wird.

Aber so funktioniert Lernen in Wirklichkeit gar nicht?

Cheng: Anscheinend funktioniert Lernen aber nicht graduell, sondern eher in Sprüngen. Irgendwann ist man von null auf hundert. Das hat auch gar nichts mit Einsicht zu tun. Das sehen wir in unseren Modellen, die ganz einfache Lernregeln haben.

Wenn man davon genug Einheiten in einem Netzwerk zusammenschaltet, verhält sich das Netzwerk plötzlich sehr unerwartet. Es lernt Dinge innerhalb nur eines Versuchs. Obwohl die Einzelteile nur Assoziationen lernen und lokal sehr wenig ändern, kann sich das im ganzen System nicht-linear aufsummieren und so zu plötzlichen Verhaltensänderungen führen.

Diese Sprünge, nach denen sich das Verhalten abrupt verändert, sowie extreme Unterschiede zwischen Individuen beobachten wir auch bei Menschen, Ratten und Tauben. Aber wenn man sich Lehrbücher anguckt, sieht man immer gemittelte graduelle Lernkurven.

Nutzen auch andere Wissenschaftlerinnen und Wissenschaftler Ihre KI-Modelle?

Cheng: Es gibt einige, die sie vielleicht gern übernehmen würden, wir müssen aber erst zeigen, inwieweit sie funktionieren, und Erkenntnisse bringen, die man sonst nicht hätte.

Üngör: In unserem Sonderforschungsbereich setzen bereits viele Wissenschaftlerinnen und Wissenschaftler experimentelle Versuchspläne ein, die wir mit KI-Unterstützung entwickelt haben. Diese können dann im Humanbereich mit relativ einfachen Versuchsanordnungen, wie der prädiktiven Lernaufgabe, umgesetzt werden. Prädiktive Lernaufgaben sind spezielle Kategorisierungsaufgaben, wie sie schon seit Jahrzehnten in Experimenten genutzt werden.

Zum Beispiel nehmen die Teilnehmenden unseres Versuchs die Rolle einer Ärztin ein, deren Patient unter Bauchschmerzen leidet. Nun soll sie herausfinden, auf welche Nahrungsmittel der Patient allergisch reagiert und welche harmlos für ihn sind. Im Versuch gibt die Ärztin dem Patienten verschiedene Dinge zu Essen und kann direkt beobachten, wie dieser reagiert. Solche Aufgaben kann man an viele Fragestellungen anpassen und so gezielt und sehr schnell bestimmte Lernerfahrungen bei den Teilnehmenden herstellen, die dann im Laufe des Experiments verändert werden können.

Welche Rolle spielt die KI dabei?

Üngör: Häufig möchten wir in einem Experiment zwei miteinander konkurrierende Theorien gegeneinander testen, die einen Sachverhalt über unterschiedliche Mechanismen erklären. Dafür schaffen wir Situationen, in denen die beiden Theorien zu unterschiedlichen Vorhersagen darüber führen, wie sich eine Versuchsperson verhalten wird. Simulationen können dazu beitragen, die Anzahl der notwendigen Experimente zu reduzieren.

Diese prädiktiven Lernexperimente im Humanbereich ersetzen zunehmend Tierexperimente.

Benötigt man für diese Experimente noch Versuchstiere?

Üngör: Diese prädiktiven Lernexperimente im Humanbereich ersetzen zunehmend Tierexperimente. Es gibt immer mehr Arbeitsgruppen, die früher rein tierexperimentell gearbeitet haben und inzwischen entweder komplett in den Humanbereich gewechselt sind oder Humanexperimente ergänzend verwenden.

Cheng: KI-Modelle können eventuell die Anzahl der benötigten Experimente an Tieren reduzieren, die man sonst machen würde, um herauszufinden, welche Hirnareale wichtig sind und welche nicht. Ich kann auch im Vorfeld ausprobieren, wie viele neuronale Ableitungen benötigt werden, um im Versuch überhaupt ein aussagekräftiges Ergebnis zu bekommen.

Wird man irgendwann die Funktion des gesamten menschlichen Gehirns verstehen?

Cheng: Ich glaube, dass wir das eines Tages können, aber vermutlich in ferner Zukunft. Es gibt vieles, das mein Gehirn nicht begreift, aber ich kann diese Dinge programmieren und als Simulation ablaufen lassen. Daraus ziehe ich dann meine Schlüsse. So gesehen kann mir vielleicht sogar die KI dabei helfen, mein Gehirn zu verstehen: indem sie die Daten in einer Art aufbereitet, die ich begreifen kann.